De Tweede Kamerverkiezingen verliepen – voor zover nu bekend – zonder grote incidenten. De Autoriteit Consument & Markt (ACM) hield in de gaten of online platforms voldoende maatregelen namen om het risico op misleiding en inmenging tegen te gaan. Hoe pakte de ACM dat aan en moest ze ingrijpen? Een gesprek met bestuurder Manon Leijten. “Het is een marathon, maar we zijn goed uit de startblokken gekomen.”

In de VS beïnvloedden duizenden Russische nepacounts op Facebook, Instagram en Twitter het politieke debat bij de presidentsverkiezingen in 2016. Tijdens de Europese verkiezingen van 2024 dook op X een groot online desinformatie-netwerk op. En in Roemenië zorgden tienduizenden valse TikTok-accounts er recent voor dat de pro-Russische Călin Georgescu onverwacht de eerste ronde van de presidentsverkiezingen won.

Deze voorbeelden laten zien dat het digitale verkiezingslandschap kwetsbaar is. “En dat terwijl kiezers hun informatie steeds vaker online halen”, zegt Leijten. “De informatie moet daarom betrouwbaar zijn. Grote platforms moeten maatregelen treffen die hieraan bijdragen.” De Europese Unie kwam in 2024 met de Digital Services Act (DSA). Deze wet verplicht online diensten om snel en zorgvuldig te reageren op meldingen van illegale en misleidende content, transparant te zijn over hun algoritmes en maatregelen te nemen tegen negatieve effecten op verkiezingsprocessen.

“We werken signaalgedreven. We struinen niet zelf het internet af op online inmenging.”

De ACM is sinds begin dit jaar bevoegd om toezicht te houden op de naleving van de nieuwe wet. Het toezicht op platforms zoals TikTok, Facebook en X ligt bij de Europese Commissie, maar de ACM is als Digital Services Coordinator de ogen en de oren van de Commissie. “We hadden richting de verkiezingen een paar maanden de tijd om ons goed voor te bereiden op deze nieuwe rol”, vertelt Leijten. “We hebben een team van zo’n 25 mensen samengesteld en geïnstrueerd. Zij volgden een in Europees verband opgesteld draaiboek.”

Rondetafelgesprek met platforms

Een belangrijk onderdeel van het draaiboek was het goed informeren van online dienstverleners en overige partners over de nieuwe wet en hun rol daarin. Leijten: “We stuurden de tien grootste platforms eerst een brief over hun verantwoordelijkheden. Denk aan Facebook, Instagram, Google, TikTok en X. Daarna hielden we een rondetafelgesprek met deze platforms en vertegenwoordigers van onder meer Binnenlandse Zaken, Autoriteit Persoonsgegevens, ngo’s en wetenschappers. Iedereen was aanwezig, behalve X; zij meldden dat er problemen waren met hun vlucht.”

Tijdens het overleg lichtte de ACM toe wat ze van de platforms verwachtte. “Wij beantwoordden hun vragen en hebben onze rol toegelicht. Andersom vertelden zij welke maatregelen zij namen om ervoor te zorgen dat kiezers op hun platforms eerlijke informatie zouden vinden.”

Leijten benadrukt dat de ACM niet zelf het internet afstruinde naar online inmenging. “Dat is niet onze taak. Ook niet bij toekomstige verkiezingen. We werken signaalgedreven. Burgers en partijen die nepnieuws of misleidende berichten zien of vermoeden dat een netwerk gehackt is, moeten dat makkelijk kunnen melden bij het betreffende platform. Dat is de eerste stap. Reageert het platform niet snel en adequaat, dan kan de melder ons inschakelen. Wij houden de vinger aan de pols of het platform zorgvuldig met meldingen omgaat en welke maatregelen het neemt.”

Slechts 26 meldingen

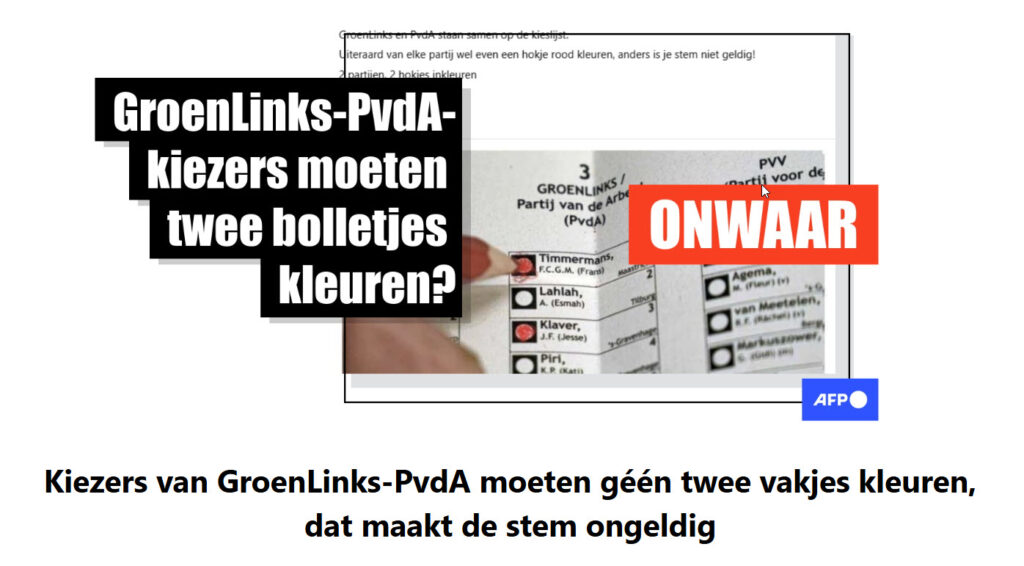

Bij de Tweede Kamerverkiezingen nam de ACM 26 meldingen in behandeling. Dat ging om verschillende problemen op verschillende platforms. Eén voorbeeld: op X en Facebook verspreidde iemand een afbeelding van een stembiljet met twee ingekleurde bolletjes bij Groenlinks-PvdA en daarbij de tekst: ‘LET OP: GroenLinks en PvdA staan samen op de kieslijst. Uiteraard van elke partij wel even een hokje rood kleuren, anders is je stem niet geldig! 2 partijen, 2 hokjes inkleuren.’ Het bericht werd honderden keren gedeeld. Misleidende informatie, want bij twee ingekleurde bolletjes is het stembiljet juist ongeldig.

“Toen wij de melding kregen, hebben we direct contact opgenomen met X en Facebook.”

“Toen wij de melding kregen, hebben we direct contact opgenomen met X en Facebook”, vertelt Leijten. “Ze handelden adequaat: Facebook verwijderde het bericht meteen, X plaatste er een waarschuwing bij en beperkte de zichtbaarheid.”

Dat er slechts 26 signalen binnenkwamen, verraste de ACM. Waren er daadwerkelijk weinig misleidende berichten en nepaccounts? Hadden de platforms hun zaakjes goed op orde? Of wisten gebruikers de weg naar de waakhond moeilijk te vinden? “We evalueren nog. Het is nog te vroeg voor definitieve conclusies, maar het voorlopige beeld is dat de verkiezingen zonder hele grote incidenten zijn verlopen.”

Samenwerking in een ecosysteem

Leijten heeft een gemengd beeld over de samenwerking met de platforms. “Ze waren an sich goed bereikbaar en reageerden snel bij incidenten. Maar bij de rondetafel bleven ze soms op de vlakte en waren de antwoorden op vragen over de maatregelen die ze namen regelmatig heel algemeen.” Dat het formele toezicht op de grote techbedrijven bij de Europese Commissie ligt en de ACM zelf geen zware sancties kan opleggen, vindt ze logisch. “Het gaat om platforms die in heel Europa actief zijn. Wij zijn de ogen en oren van de Commissie en delen de signalen met hen. De samenwerking is goed en de lijntjes zijn heel kort.”

“Als de bekendheid groter wordt, komen er misschien ook meer meldingen binnen.”

Leijten is ook tevreden over de samenwerking met andere partners. “Bij de uitvoering van de Digital Services Act zijn veel partijen betrokken: van politie en Openbaar Ministerie tot de Kiesraad, Autoriteit Persoonsgegevens, onderzoekers en ngo’s. Ieder heeft een eigen rol. Samen vormen we een netwerk dat helpt om online risico’s snel te zien en effectief aan te pakken.”

Melden, melden, melden

Leijten noemt de uitvoering van de DSA een marathon. “We zijn net begonnen en goed uit de startblokken gekomen. Ons team was goed voorbereid, handelde snel en adequaat en stond 24/7 klaar. Daar ben ik trots op.” Ze ziet ook verbetermogelijkheden voor de volgende verkiezingen, die er al snel aankomen: de gemeenteraadsverkiezingen in maart 2026. “Mensen en organisaties weten soms wel de media te vinden bij incidenten, maar melden die niet bij het platform of bij ons. De voorlichting over wat mensen zelf kunnen doen kan dus nog beter, zeker ook met het oog op de gemeenteraadsverkiezingen. De belangrijkste boodschap is: melden, melden, melden. Eerst bij het platform zelf, en vervolgens bij ons als zij niet snel of adequaat optreden. Alleen dan kan het systeem van de DSA zijn werk doen.”